当汉服遇上激光雷达:这群00后用手机扫描开启3D试衣革命——东方元境以自主技术打破虚拟服饰“次元壁”

来源:中国教育晚报 作者:宸跃 发布时间:2025-06-06

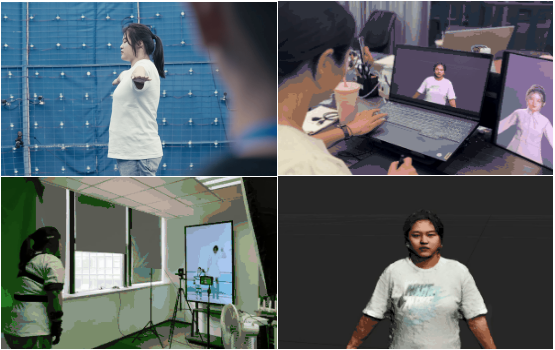

在宁波大学创业园的一间实验室里,23岁的黄培琰正用一部普通手机扫描同伴的身体轮廓。10秒后,屏幕上生成毫米级精度的3D人体模型;轻点选项,一件数字化汉服瞬间“穿”在模型身上,衣袂飘动的褶皱光影与真实布料无异——这正是东方元境团队研发的“时空LOD四维孪生引擎”技术落地场景。这群平均年龄21岁的创业者,用三年时间攻克了虚拟服饰体验的三大技术壁垒。

部分团队成员合影

突破一:让手机变身3D扫描仪

技术核心:激光雷达+SPAD传感器融合算法

团队创造性利用消费级设备实现专业建模。通过自研的激光雷达解析系统,将iPhone内置的dToF激光雷达精度提升至0.1毫米级(传统方案为5毫米),并突破性适配安卓机型。

“就像给手机装上‘透视眼’,”技术负责人钱啸杰演示时说道,“SPAD传感器通过捕捉光子飞行时间,配合我们设计的抗干扰算法,即使在强光下也能精准构建人体14万个坐标点。”

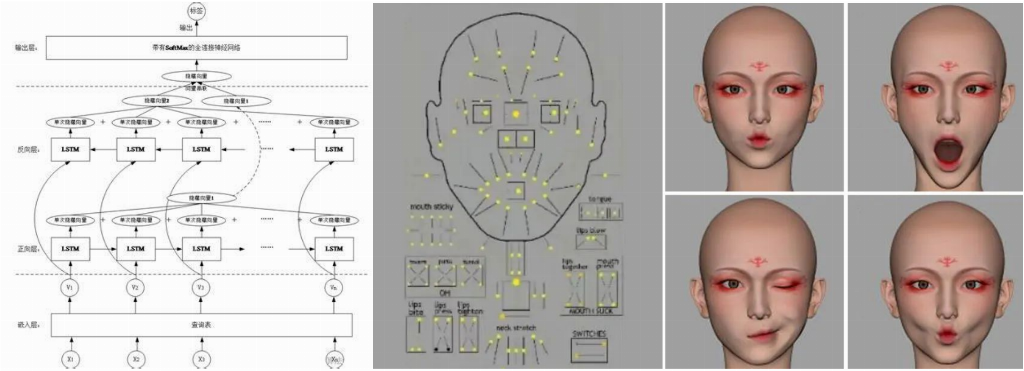

突破二:给数字人注入“情感灵魂”

技术核心:90ms微表情反馈系统

团队的核心创新在于其90毫秒微表情反馈系统。当用户触摸虚拟汉服上的纹样时,屏幕中的AI数字人能够立即做出自然反应,例如瞳孔微扩、嘴角上扬,仿佛拥有真实情感。这得益于其自研的“情感计算中台”。该系统运用光场驱动面部绑定技术,通过512个精密的控制点捕捉并重现包括睫毛颤动在内的超细腻表情。同时,其多模态记忆中枢基于Transformer架构,能深度理解用户指令的语义(如“展示唐代齐胸襦裙的行走效果”),驱动数字人做出相应反馈。相较于表情呆板的传统虚拟试衣模特,该团队的数字人反应延迟仅90毫秒,比人类眨眼速度快3倍,实现了仿生级的自然交互。

“传统虚拟试衣模特表情呆板,而我们的数字人反馈延迟仅90毫秒,比人类眨眼快3倍。”团队成员於子泫展示着苏绣数字人的灵动表情。

90ms微表情反馈系统

突破三:破解传统文化数字化难题

技术核心:AIGC+区块链非遗数据库

针对传统纹样在数字化过程中易失真的痛点,团队打造了全球首个汉服元素基因库,核心技术包括:

IP原子化引擎:将云锦、缂丝等1200种非物质文化遗产工艺解构为可灵活重组的基础模块;

区块链存证系统:为每件数字汉服生成唯一的NFT指纹,显著提升版权维权效率达30%;

物理仿真引擎:能够精确模拟纱罗等传统织物细微至0.01毫米的透光特性,确保虚拟服饰的物理表现高度逼真。

逼真的虚拟服饰

技术落地:从实验室走向产业

该技术在宁波服装博物馆的实际应用中已展现出多重价值:

显著降本增效:设计师利用AI纹样混搭工具,可将新品开发周期从45天大幅压缩至72小时。

践行绿色减碳:通过数字样衣替代实体打版,单季度即可减少面料浪费约12吨。

促进文化传承:成功利用3D建模复原了如“百鸟裙”等失传工艺,吸引了大量年轻用户,相关咨询量激增300%。

“我们要让技术成为文化的翻译器,”黄培琰指着屏幕上旋转的敦煌飞天数字服饰说,“当Z世代用手机就能穿戴文物级汉服时,文化传承便有了新通路。”目前,该团队已与宁波市元宇宙学会联合起草《虚拟服饰物理仿真标准》,其技术模块正接入杭州亚运会数字服饰展陈系统。

样板上身效果展现

创新方案解决行业痛点

团队的技术方案直击行业传统痛点:

针对专业3D扫描设备昂贵的问题,创新利用手机激光雷达扫描技术,建模成本降低90%;

针对虚拟服饰僵硬失真的问题,开发了物理级布料仿真系统,将褶皱模拟误差控制在2%以内;

针对数字人表情呆板的问题,实现了90毫秒微表情反馈系统,达到仿生级自然度;

针对数字版权保护薄弱的问题,应用区块链纹样存证技术,使侵权追溯效率提升30%。

项目负责人演示软件使用方法

这支由建筑学、服装设计、计算机专业学生组成的跨界团队,正将技术深度融入文化肌理。正如他们在实验室墙上的标语所写:“我们织造的不仅是代码,更是文明基因的数字载体。”在数字经济与传统文化碰撞的时代浪潮中,东方元境用硬核技术搭建起穿越千年的桥梁。